Em fevereiro de 2026, o Juiz Jed Rakoff decidiu no caso US v. Heppner que conversas de um réu com...

Analisamos os Termos e Condições e Políticas de Privacidade das principais IAs utilizadas pelos advogados. Veja uma avaliação comparativa, riscos e recomendações

"Adotar a inteligência artificial é abraçar o progresso e a modernidade na advocacia. Mas lembre-se: enquanto a tecnologia impulsiona seu escritório para o futuro, a negligência com os dados pode fazer seu castelo desmoronar num piscar de olhos.”

"

Foram examinados os documentos contratuais e políticas de privacidade das seguintes plataformas:

Para o Qwenlm, não foram localizados os documentos pertinentes, o que constitui, por si só, um elemento de risco relevante para consideração dos operadores jurídicos.

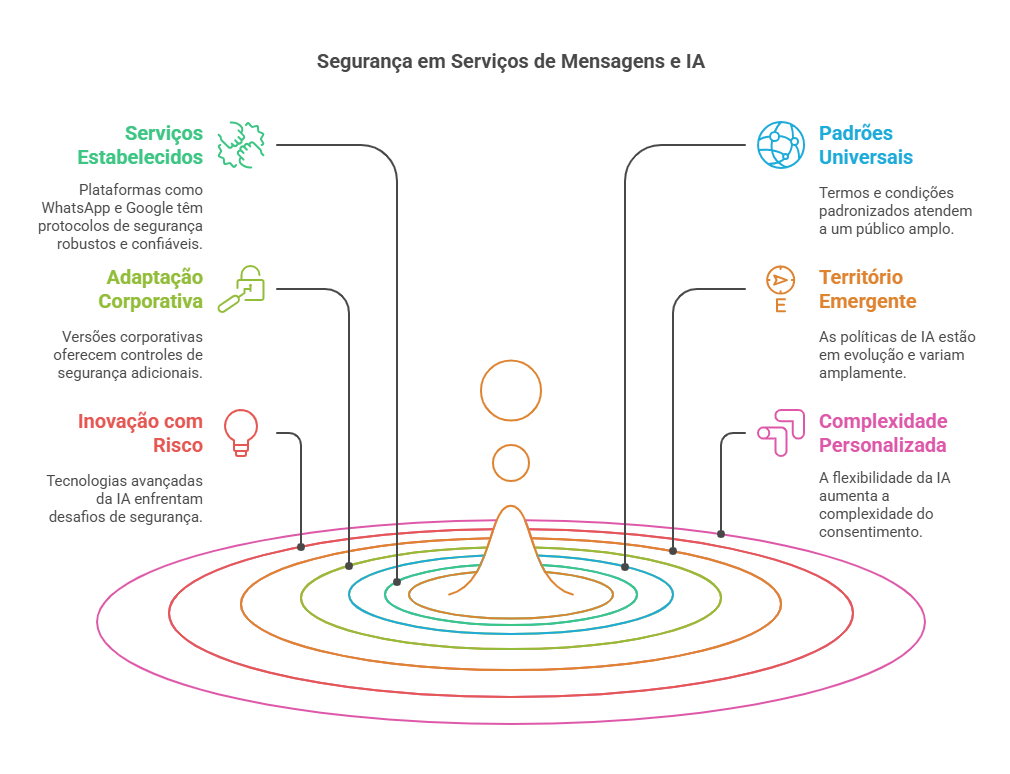

No cotidiano dos escritórios de advocacia, é comum a utilização de ferramentas amplamente difundidas – como o WhatsApp para comunicação instantânea e os serviços de e-mail do Google, Microsoft, além de provedores como Hostgator, Hostinger e LocaWeb – para trocar informações que frequentemente carregam um alto grau de confidencialidade.

Contratos, documentos de divórcio, acordos de guarda e dados de saúde circulam diariamente por esses canais.

Essas empresas, que conquistaram a confiança dos usuários no Brasil, adotam políticas de segurança e termos de uso padronizados que, embora robustos, muitas vezes não contemplam as especificidades e a criticidade dos dados manejados na prática jurídica.

Acreditamos que as plataforma de IA seguirão o mesmo caminho. Em pouco tempo as políticas de segurança serão ainda mais robustas, o que aumentará o nível de confiança dos usuários no Brasil.

Fontes pesquisadas:

| Empresa | Termos e Condições | Política de Privacidade |

|---|---|---|

| OpenAI/ChatGPT | https://openai.com/policies/terms-of-use | https://openai.com/policies/privacy-policy |

| Google Gemini API | https://ai.google.dev/gemini-api/terms | https://support.google.com/gemini/answer/13594961?hl=en |

| Google NotebookLM Enterprise | https://cloud.google.com/terms (Sujeito aos Termos de Serviço do Google Cloud) | https://cloud.google.com/security/privacy |

| Felo.ai | https://account.felo.ai/policies/terms-of-use | https://account.felo.ai/policies/privacy-policy |

| Perplexity.ai | – | https://www.perplexity.ai/hub/legal/privacy-policy |

| Gamma.app | – | https://gamma.app/privacy-8-12-2022 |

| DeepSeek | – | https://cdn.deepseek.com/policies/en-US/deepseek-privacy-policy.html |

| Qwenlm | Não encontrado | Não encontrado |

| Claude.ai (Anthropic) | https://www.anthropic.com/legal/consumer-terms | https://www.anthropic.com/legal/privacy |

| Napkin.ai | – | https://www.napkin.ai/privacy/ |

A análise engloba os documentos de termos de uso e políticas de privacidade de diversas soluções de inteligência artificial, com foco na proteção de dados sensíveis, segurança digital e conformidade com a LGPD.

É fundamental que advogados que utilizam essas IAs estejam atentos tanto às medidas técnicas e organizacionais implementadas quanto às cláusulas contratuais que possam impactar a responsabilidade profissional e a proteção da privacidade dos clientes.

| Plataforma | Mencionam explicitamente nas Políticas de Privacidade que os dados estão protegidos e não serão utilizados/expostos | Nível de Segurança |

|---|---|---|

| OpenAI/ChatGPT | ✓ | 🟢 |

| Google Gemini API | ✓ | 🟢 |

| Google NotebookLM Enterprise | ✓ | 🟢 |

| Felo.ai | ✓ | 🟢 |

| Perplexity.ai | ✗ | 🟡 |

| Gamma.app | ✗ | 🟡 |

| DeepSeek | ✓ | 🟡 |

| Qwenlm | ✗ | 🔴 |

| Claude.ai (Anthropic) | ✓ | 🟢 |

| Napkin.ai | ✓ | 🟡 |

Os termos apresentam estrutura robusta e detalhada, com seções específicas sobre tratamento de dados. Contudo, observa-se linguagem ampla quanto ao uso de conteúdos inseridos (“inputs”) para treinamento e aprimoramento de modelos, o que pode gerar questionamentos sob a ótica da LGPD.

A documentação do Google apresenta maior granularidade e especificidade no tratamento diferenciado entre dados pessoais e dados de treinamento. A vinculação aos Termos de Serviço do Google Cloud para o NotebookLM Enterprise traz camada adicional de conformidade corporativa, incluindo certificações internacionais de segurança.

Estas plataformas apresentam documentação menos madura em comparação com as líderes de mercado, com destaque negativo para inconsistências na tradução para português e lacunas na especificação de mecanismos concretos de proteção de dados.

Apresenta documentação contratual que equilibra clareza e abrangência, com seções específicas sobre dados de entrada e comprometimento explícito com a não-utilização de dados inseridos para treinamento sem consentimento específico.

| Plataforma | Criptografia | Controle de Acesso | Retenção de Dados | Localização do Processamento |

|---|---|---|---|---|

| OpenAI/ChatGPT | Implementada em trânsito e em repouso | Granular, com opções premium para empresas | 30 dias por padrão, extensível | Predominantemente EUA |

| Google Gemini API | Padrão empresarial | Integrado ao IAM do Google Cloud | Configurável para clientes enterprise | Conforme região do Google Cloud |

| Claude.ai | Implementada em múltiplas camadas | Recursos avançados na versão enterprise | Política de minimização de retenção | Predominantemente EUA |

| Plataformas emergentes | Variável, frequentemente subdetalhada | Limitado, frequentemente binário | Frequentemente não especificado | Majoritariamente sem especificação clara |

A maioria das plataformas analisadas opera sob o modelo de consentimento como base legal primária, o que gera complexidades no ambiente corporativo jurídico, onde o tratamento de dados de terceiros (clientes do escritório) ocorre frequentemente.

Claude.ai e Google (enterprise) apresentam abordagens mais sofisticadas quanto ao papel de operador/controlador, com menções explícitas a contratos de processamento de dados que podem ser customizados.

OpenAI, Google e Claude.ai incorporam mecanismos específicos para atendimento aos direitos dos titulares previstos no Art. 18 da LGPD. As plataformas emergentes frequentemente limitam-se a declarações genéricas sem procedimentos operacionais claros.

Todas as plataformas analisadas apresentam desafios quanto à adequação ao Art. 33 da LGPD (transferência internacional), com predominância de processamento em servidores norte-americanos. Google oferece opções de regionalização de dados em sua versão enterprise, aspecto relevante para conformidade.

A inserção de informações de clientes nestas plataformas pode configurar potencial violação do dever de sigilo profissional (Art. 34, VII do Estatuto da OAB) se não forem implementados controles adequados. Plataformas que utilizam dados de entrada para treinamento de modelos representam risco agravado.

A ausência de cláusulas específicas sobre o papel da plataforma como operadora de dados no contexto da LGPD pode gerar ambiguidade quanto à responsabilidade em caso de incidentes.

A maioria das plataformas não oferece mecanismos robustos de auditoria e preservação de evidências, aspecto crítico no contexto processual.

A tecnologia de IA pode transformar a prática jurídica, mas não adianta querer mudar os termos de condições de empresas estrangeiras ou dar recomendações vagas.

Na prática, é preciso agir com cautela: se não quiser expor dados sensíveis, substitua nomes e informações identificáveis por termos genéricos. Plataformas líderes, como Google Enterprise, Claude.ai Enterprise e OpenAI Enterprise, oferecem maior segurança, mas exigem que você implemente salvaguardas adicionais.

Já as plataformas emergentes têm riscos maiores e devem ser usadas apenas para dados não sensíveis ou após negociações específicas.

Mantenha-se sempre atualizado com as mudanças nos contratos dessas plataformas e com a evolução da jurisprudência, tanto no âmbito do ANPD quanto nos tribunais brasileiros.

"Se não quiser expor dados sensíveis, substitua nomes e informações identificáveis por termos genéricos. Plataformas líderes, como Google Enterprise, Claude.ai Enterprise e OpenAI Enterprise, oferecem maior segurança, mas exigem que você implemente salvaguardas adicionais.

"

"A IA coloca no seu colo a chance de transformar a prática jurídica e superar desafios. Contudo, a verdadeira vitória depende de não dar bobeira com a segurança dos dados dos clientes.

"

Os advogados podem utilizar as IAs mencionadas, mas com ressalvas e medidas mitigatórias específicas.

Não existe uma proibição legal expressa, porém há riscos significativos que demandam controles adequados para a conformidade com a LGPD e demais normativas, especialmente o Código de Ética e Disciplina da OAB.

| Atividade Jurídica | OpenAI Enterprise | Google Enterprise | Claude Enterprise | Plataformas Emergentes |

|---|---|---|---|---|

| Revisão de contratos sem dados pessoais | 🟢 | 🟢 | 🟢 | 🟡 |

| Revisão de peças com dados sensíveis | 🟡 | 🟡 | 🟡 | 🔴 |

| Elaboração de pareceres genéricos | 🟢 | 🟢 | 🟢 | 🟡 |

| Elaboração de pareceres com informações confidenciais | 🟡 | 🟡 | 🟡 | 🔴 |

| Pesquisa jurisprudencial | 🟢 | 🟢 | 🟢 | 🟢 |

| Análise de documentos de diligência (due diligence) | 🔴 | 🟡 | 🟡 | 🔴 |

| Automatização de documentos padronizados | 🟢 | 🟢 | 🟢 | 🟡 |

| Gestão de casos e informações de clientes | 🔴 | 🔴 | 🔴 | 🔴 |

| Análise predictiva de resultados processuais | 🟡 | 🟡 | 🟡 | 🔴 |

| Comunicação com clientes via IA | 🔴 | 🔴 | 🔴 | 🔴 |

Legenda:

O uso de IAs no ambiente jurídico brasileiro não constitui violação automática à LGPD ou ao Código de Ética da OAB, desde que implementados controles proporcionais aos riscos. As versões enterprise das plataformas consolidadas (OpenAI, Google e Claude) apresentam perfil de risco mais aceitável para uso profissional, enquanto plataformas emergentes devem ser limitadas a casos de menor sensibilidade.

O elemento determinante não é o uso em si, mas a natureza dos dados inseridos e os controles implementados pelo escritório ou profissional. A responsabilidade pela conformidade permanece integralmente com o advogado, independentemente das limitações contratuais das plataformas.

Ouça uma reflexão rápida no PodCast

"A inteligência artificial é a faísca que acende a revolução na advocacia – um futuro de eficiência e inovação. Mas, se o advogado vacilar com a proteção dos dados, o incêndio pode virar tragédia.

"

Desde de 2012 temos ajudado o mercado jurídico a evoluir.

Em fevereiro de 2026, o Juiz Jed Rakoff decidiu no caso US v. Heppner que conversas de um réu com...

Modelos de linguagem não sabem coisas, geram texto estatisticamente plausível. Quando não têm a resposta, inventam. Com fluência perfeita e...

A maioria dos advogados que usa inteligência artificial hoje digita prompts genéricos e recebe respostas genéricas. Estes 12 assistentes personalizados...

A pesquisa da Anthropic sobre impacto da IA no mercado de trabalho traz um dado que inverte o senso comum:...

Antes que qualquer magistrado leia sua petição, um algoritmo já classificou, etiquetou e decidiu seu destino. Adjetivos viram ruído, saltos...

Milhares de advogados digitam prompts genéricos e publicam textos que ninguém lê. O problema não é a inteligência artificial —...

A maioria dos advogados peticiona sem saber quase nada sobre quem vai decidir o caso. Sem dados sobre o magistrado,...

Estamos redefinindo os APPs da Advoco. Em breve iremos apresentar novas funcionalidades e opções ainda mais avançadas para você aprimorar sua produção jurídica e eficiência.

Caso você tenha alguma urgência, ou esteja utilizando os APPs de forma regular, fale conosco.

Planejar no PowerPoint é fácil; fazer gente ocupada remar pro mesmo lado é outra história. A Advoco junta todos os sócios na mesma mesa, corta o consultês e traduz visão de futuro em escolhas claras: onde atuar, quanto crescer e o que largar pelo caminho.

| Visão sem blá-blá-blá | Nicho que paga a conta |

| Olho-no-olho, alinhamos objetivos e métricas em uma página. Todo mundo sai sabendo para onde o escritório vai — e por quê. | Chega de abraçar o mundo. Definimos áreas foco onde o escritório gera mais valor (e reputação) e descartamos o resto. |

| Prioridades de crescimento | Ritmo de execução |

| Metas trimestrais enxutas e negociadas entre os sócios: novos clientes, ticket médio e equipes alocadas. Nada de listas infinitas. | Implantamos rituais rápidos: reuniões de 20 min, quadro de avanços e decisões semanais. Estratégia vira hábito, não evento anual. |

Chega de tarefas voando sem dono. A Advoco Brasil desenha o mapa completo do seu escritório: papéis, entradas, saídas e conexões entre Jurídico, Financeiro, Paralegal e Administração. Depois, pluga tecnologia para que tudo rode no piloto-automático — eficiência antes de tudo.

| Quem faz, por que faz | Fluxo sem fricção |

| Definimos papéis e KPIs para que cada pessoa saiba o que entregar e por qual razão — zero ambiguidade, zero “achismos”. | Transformamos atividades dispersas em um pipeline visual; status, prazos e responsáveis visíveis para todos. |

| Tecnologia que libera tempo | Integração sem muros |

| Automatizamos tarefas repetitivas com low-code, IA e RPA; seu time foca no que realmente importa. | Conectamos Jurídico, Financeiro e Administrativo em um único ecossistema de dados — informação certa, no lugar certo, na hora certa. |

Cansado de planilhas confusas, metas genéricas e discussões eternas sobre “quanto cobrar”?

A Advoco Brasil simplifica — e fortalece — a gestão do dinheiro: precificamos honorários em linha com seu posicionamento, definimos metas de faturamento por carteira (contínua ou avulsa) e estruturamos regras claras de distribuição de lucros. No fim, tudo chega a um dashboard dinâmico que entrega transparência total e acelera a tomada de decisões.

| Preço que impulsiona crescimento | Metas que enxergam cada cliente |

| Hora-banco? Só se fizer sentido. Criamos modelos de precificação baseados em valor estratégico, margem alvo e diferenciação — não apenas em horas vendidas. | Receita toda misturada confunde estratégia. Separamos metas por clientes de partido, projetos avulsos e contencioso de massa, revelando onde investir energia. |

| Lucro claro, jogo limpo | Dashboard em tempo real |

| Distribuição nebulosa é convite ao conflito. Definimos regras transparentes de partilha: pró-labore, reserva de caixa e bônus por resultado—sem espaço para dúvidas. | Número que não aparece não influencia. Implantamos painéis que exibem KPIs financeiros ao vivo (ticket médio, margem, realização) para decisões rápidas e baseadas em dados. |

Como garantir motivação, retenção e crescimento quando faltam clareza de papéis, trilha de carreira e critérios de remuneração?

A Advoco Brasil mapeia a maturidade de cada profissional — júnior, pleno ou sênior — define expectativas objetivas por função e conecta PDIs aos planos estratégicos do escritório. Resultado: equipes engajadas, liderança previsível e desenvolvimento alinhado ao futuro do negócio.

| Sem trilha, sem destino | Feedback que move, não queima |

| Quem não enxerga o próximo passo trava. Estruturamos um mapa de carreira transparente e justo, para que cada advogado saiba onde está e até onde pode chegar. | Talento sem orientação vira turnover. Implantamos ciclos de feedback contínuo e PDIs práticos para transformar pontos cegos em ações de melhoria mensuráveis. |

| Remuneração que faz sentido | Estratégia = Pessoas em ação |

| Planos de pagamento confusos minam o engajamento. Criamos modelos de remuneração baseados em mérito, metas e valor entregue, alinhados aos resultados do escritório. | Visão sem execução é slide. Ligamos o desenvolvimento individual às metas estratégicas, garantindo que cada competência nova impulsione objetivos coletivos. |

Com a ferramenta inovadora da AdvocoBrasil, você controla suas comissões de forma fácil, rápida e segura.

Nossa ferramenta:

Com esta ferramenta simples, porém inovadora da Advocobrasil, você precifica seus honorários em segundos, com precisão e confiança.

Nossa ferramenta:

Como lidar com a falta de alinhamento, as limitações, ansiedades, perdas de controle, egos inflados e a falta de visão dos sócios?

Nossa abordagem avalia quão alinhados os sócios estão com a visão de gestão atual, conexão com o futuro e principalmente sobre a clareza de seus papeis e responsabilidades de liderança.

Liderar um escritório de advocacia exige mais do que conhecimento jurídico.

É necessário visão estratégica, capacidade de inspirar e impulsionar o crescimento. A Advoco Brasil ajuda criando um ambiente de alto desempenho e cultivando uma cultura de inovação.

As ferramentas digitais, as novas leis e as demandas dos clientes exigem adaptabilidade e visão de futuro.

AdvocoBrasil ajuda a identificar as tendências do mercado e a desenvolver estratégias para se manter competitivo e relevante, com metodologias de Gestão de Mudanças.

Atrair novos clientes e fidelizar os existentes é fundamental.

A AdvocoBrasil te ajuda a desenvolver estratégias de marketing jurídico eficazes, a construir relacionamentos sólidos com clientes e a identificar novas oportunidades de negócio.