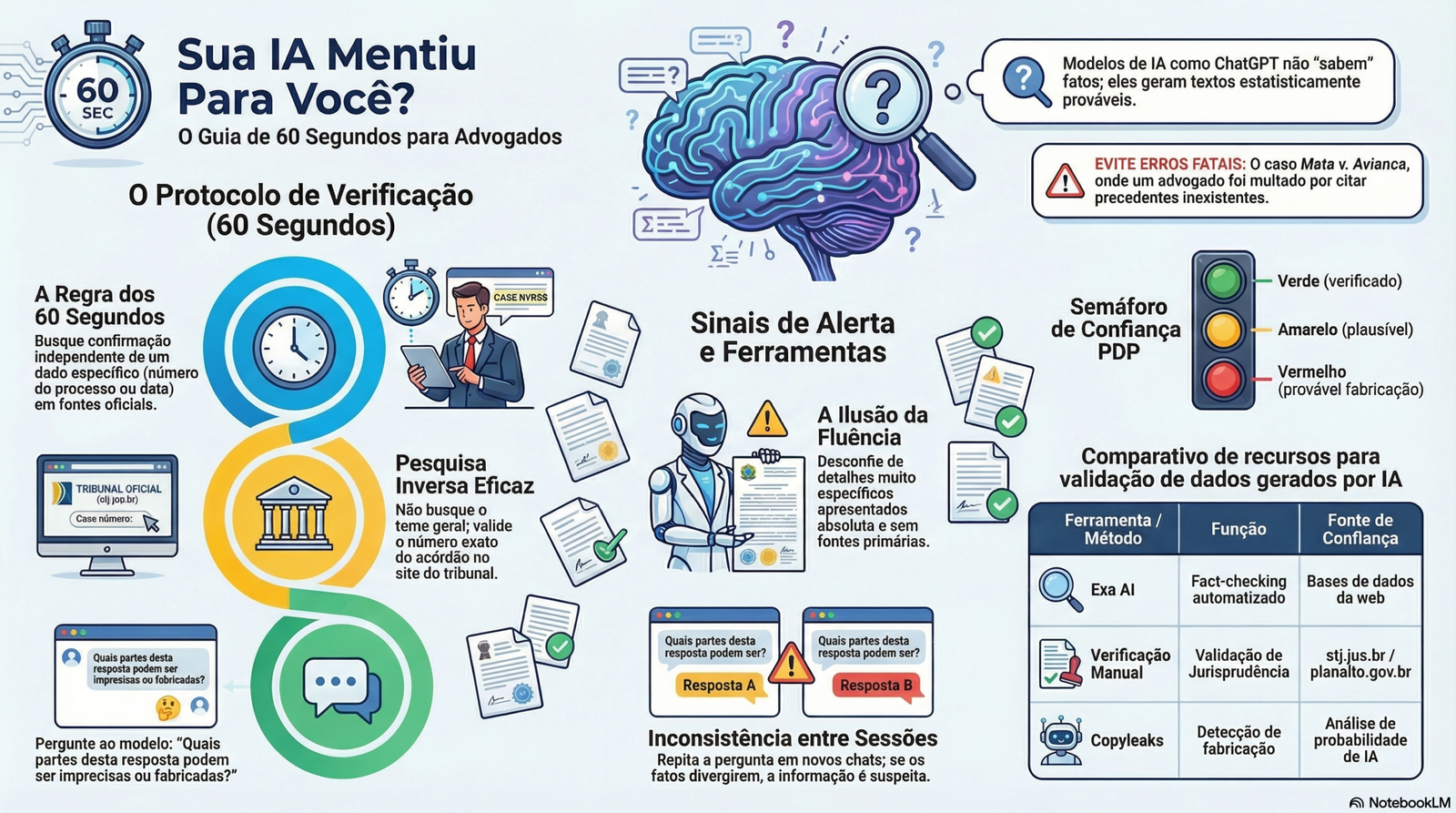

Em março de 2024, um advogado de Nova York apresentou uma petição com seis precedentes jurisprudenciais citados pelo ChatGPT. Nenhum existia. O juiz aplicou multa de US$ 5.000 ao advogado e ao escritório. O caso Mata v. Avianca virou referência mundial sobre os riscos de confiar cegamente em inteligência artificial generativaModelos como ChatGPT, Claude e Gemini que geram texto, código e imagens com base em padrões estatísticos — não em compreensão factual..

Isso não é exceção. É o comportamento padrão. Modelos de linguagem geram texto estatisticamente plausível. Quando não têm a resposta, inventam. Com fluência perfeita e confiança absoluta. O nome técnico é alucinaçãoQuando um modelo de IA gera informações fictícias — nomes, datas, decisões judiciais, dados — apresentando-as como fatos reais, sem sinalizar incerteza..

A questão não é se a IA vai errar. É quando você vai perceber.

Três técnicas para forçar a IA a se corrigir

A primeira linha de defesa está no próprio prompt. Três comandos reduzem drasticamente a taxa de erro — antes mesmo de a resposta chegar ao documento final.

Essas técnicas funcionam porque exploram uma característica dos modelos: eles respondem melhor quando o prompt delimita expectativas. Sem delimitação, o modelo preenche com o que for estatisticamente conveniente.

A regra dos 60 segundos

Pegue o fato mais específico da resposta — um nome, uma data, um número, uma decisão judicial. Busque no Google. Se em 60 segundos você não encontrar confirmação independente, a probabilidade de alucinação é alta.

A IA frequentemente mistura elementos reais — nomes de ministros com números de processos que não existem, ou datas corretas com ementas fabricadas. Buscar o dado específico (não o tema geral) expõe essa costura.

Quatro sinais de que a IA está alucinando

Nem toda alucinação é óbvia. Os sinais abaixo funcionam como bandeiras vermelhas para qualquer profissional que use IA em produção.

A IA afirma datas, percentuais e nomes com certeza absoluta, sem qualquer ressalva. Quanto mais específico e assertivo o detalhe, mais você deve desconfiar. Um modelo que diz "conforme o art. 478, §3°, inciso IV" sem hesitação pode estar inventando cada componente dessa referência.

Faça a mesma pergunta em dois chats diferentes. Se as respostas divergirem em fatos concretos (não apenas em estilo), pelo menos uma delas é fabricada. Se a IA cita o REsp 1.234.567 em uma sessão e o REsp 9.876.543 em outra para a mesma tese, ambos os números são suspeitos.

O texto parece substancial, mas ao reler, não contém informação verificável. Frases como "diversos tribunais têm entendido" ou "a jurisprudência majoritária aponta" sem citar qual tribunal ou qual decisão são bandeiras vermelhas. A IA está preenchendo espaço com aparência de autoridade.

A IA cita um paper de Harvard, um relatório da McKinsey ou um acórdão do STJ com naturalidade. Você busca. Não existe. Esse é o tipo mais perigoso de alucinação: parece legítimo e sobrevive a uma leitura superficial. Só a verificação direta na fonte primária revela a fabricação.

A IA erra com fluência. Sua vantagem competitiva é saber quando ela está errada.

Ferramentas que ajudam

Para quem quer automatizar parte da verificação, há opções concretas.

Função: Fact-checking automatizado contra bases de dados da web.

Uso prático: Cole a afirmação da IA e o Exa busca confirmação em fontes indexadas. Retorna resultados com score de confiança e links para as fontes originais.

Função: Detecção de conteúdo gerado por IA e análise de fabricação.

Uso prático: Submeta trechos do texto e o sistema sinaliza passagens com alta probabilidade de geração artificial, indicando onde concentrar a verificação manual.

Função: Análise de probabilidade de geração por IA em textos.

Uso prático: Analisa a perplexidade e variabilidade do texto para indicar quais trechos têm maior probabilidade de serem gerados por modelo de linguagem.

Função: Nenhuma ferramenta substitui a leitura crítica.

Uso prático: Para jurisprudência, consulte stj.jus.br. Para legislação, planalto.gov.br. Para dados estatísticos, busque a fonte primária. O site do tribunal é a única prova de que o acórdão existe.

Ferramentas automatizadas adicionam uma camada de proteção, especialmente quando o volume de produção com IA é alto. Mas a responsabilidade final é do profissional que assina.

6 conceitos que todo profissional precisa dominar

Os fundamentos da verificação anti-alucinação. Cada card revela a explicação.

Alucinação

toque para virarGeração de informações fictícias apresentadas como fatos. O modelo não "sabe" que está inventando — ele produz a sequência de tokens mais provável, mesmo que o conteúdo seja falso.

Pesquisa inversa

toque para virarBuscar o dado específico citado pela IA (número do processo, nome do autor, data exata) em vez do tema geral. Expõe a costura entre elementos reais e fabricados.

Autocrítica do modelo

toque para virarInstruir a IA a avaliar as fragilidades da própria resposta. Modelos de linguagem conseguem identificar pontos de incerteza quando direcionados a fazê-lo.

Regra dos 60s

toque para virarPegar o fato mais específico da resposta e buscar confirmação independente em 60 segundos. Se não encontrar, a probabilidade de fabricação é alta.

Prompt estruturado

toque para virarDividir perguntas complexas em etapas (sumário primeiro, depois desenvolvimento). Reduz a chance de o modelo preencher lacunas com invenções.

Semáforo de confiança

toque para virarSistema de classificação verde-amarelo-vermelho para cada afirmação factual do texto. Prioriza verificação nos itens de maior risco antes do uso profissional.

O que fazer agora

A IA acelera pesquisa, rascunhos e análises. Mas o profissional que assina o documento é você. A responsabilidade regulatória, ética e reputacional não se transfere para o modelo.

Frases que confrontam

As verdades mais desconfortáveis deste artigo. Passe o mouse para revelá-las.

A ilusão da fluência

Modelos de linguagem não sabem coisas — geram texto estatisticamente plausível.

O risco real

A questão não é se a IA vai errar. É quando você vai perceber.

A vantagem humana

A IA erra com fluência. Sua vantagem competitiva é saber quando ela erra.

O perigo invisível

Fontes que não existem são o tipo mais perigoso de alucinação: parecem legítimas para quem lê rápido.

A costura

A IA mistura elementos reais — nomes corretos com processos que não existem. Buscar o dado específico expõe.

A responsabilidade

O profissional que assina o documento é você. A responsabilidade não se transfere.